Công cụ Phân tích Robots.txt Hiệu quả

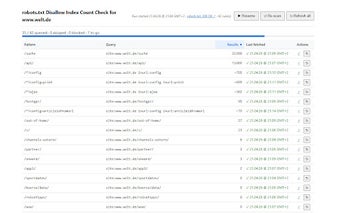

Robots Disallow Checker là một tiện ích mở rộng Chrome miễn phí được thiết kế để kiểm tra các đường dẫn mà một trang web không cho phép trong tệp robots.txt của nó, tiết lộ bao nhiêu trong số các URL này đã được Google lập chỉ mục. Công cụ này tự động hóa quá trình lấy tệp robots.txt, trích xuất các quy tắc Disallow áp dụng và tạo các truy vấn Google site: để hiển thị các URL đã được lập chỉ mục dưới mỗi mẫu không cho phép. Nó đặc biệt hữu ích cho các chuyên gia SEO và quản trị viên web cần đảm bảo rằng các đường dẫn không cho phép của họ đang được Googlebot tôn trọng.

Tiện ích mở rộng này có một bộ tính năng toàn diện, bao gồm hỗ trợ cho nhiều mẫu robots.txt khác nhau như ký tự đại diện và hậu tố loại tệp, cùng với bộ nhớ cache cục bộ 7 ngày để kiểm tra ngay lập tức. Nó cung cấp một bảng có thể sắp xếp để trình bày dữ liệu một cách có tổ chức và cho phép người dùng xuất kết quả dưới định dạng TSV hoặc Markdown. Quan trọng là, tiện ích mở rộng này nhấn mạnh quyền riêng tư của người dùng, không thu thập dữ liệu hoặc telemetry, đảm bảo rằng tất cả các hoạt động được thực hiện một cách an toàn trong môi trường cục bộ của người dùng.